头条

今日币安创始人赵长鹏认罪,正式辞任币安 CEO 一职。联想 OpenAI 的这场内斗,难道创始人离职不是最大的去中心化吗?

撰文:Peng SUN,Foresight News

上个周末,整个科技圈都被 OpenAI 内斗刷屏,马斯克的 SpaceX 二次升天也顶不过 AI 的瓜。从 CEO Sam Altman 被罢免到 OpenAI 的投资者向董事会施压与 Altman 试图重新回归 OpenAI,再到周一 Sam Altman 宣布加入微软,本以为一场闹剧结束了。但 OpenAI 内斗剧情再次反转,Sam Altman 将重返 OpenAI 担任首席执行官,并组建由 Facebook 首席技术官 Bret Taylor (主席)、奥巴马政府前首席财务顾问 Larry Summers 和 Facebook 首任 CTO Adam D'Angelo 组成的新的初始董事会。同时,OpenAI 联创 Greg Brockman 也将重返 OpenAI。爆炸星期三,AI 是真的给币圈面子,否则今天币圈只能吃币安和赵长鹏的瓜了。

「又回到最初的起点,记忆中你青涩的脸」。OpenAI 董事会与 Sam Altman 对于内部斗争实情的隐藏导致我们依然无法获悉罢免的根本原因。路线之争?沟通不畅?我不知道,也不感兴趣。与其千篇一律地猜测背后的「真相」,不如从后现代主义的视角聚焦于部分 Web3 从业者对于这一事件的讨论,观察这些讨论背后 Web3 的话语与政治。因为在很大程度上,话语的构建遮蔽了太多的细节,有利于自己的话语才会被纳入到叙事当中。但人与事是复杂的,而非简单的意识形态、主义所能涵括。

当世界顶级科技公司罢免公告发出时,舆论一片倒向所谓 OpenAI 的灵魂人物 Sam Altman 与 Greg Brockman,而投资者的行动也表明 Altman 对 OpenAI 的重要性。这场内斗已经被媒体与舆论塑造为「政变」,而首席技术官 Ilya Sutskever 则被视为「政变」的幕后推手。AI 界的大事,Web3 也并未闲着,以 Coinbase 前 CTO Balaji Srinivasan、Coinbase 联创兼 CEO Brain Armstrong、a16z 普通合伙人 Sriram Krishnan 为代表的 Web3 从业者极力主张「去中心化 AI」,拒绝有效利他主义,拒绝减速。在这种情形中,一种新的对立与话语表述悄然诞生,AI 在减速,而 Web3 则将自己建构为代表进步主义的加速与人类历史的未来。

在 OpenAI 董事会罢免 Sam Altman 的消息爆出来后,笔者留意到以 Balaji Srinivasan、Brain Armstrong 为代表的 Web3 有效加速主义者对 OpenAI 董事会的鄙夷。在他们的话语体系中,有效利他主义、AI 末日论是有效加速主义的对立面。「好」与「坏」、「中心化」与「去中心化」、「AI」与「Web3」、「国家」与「去国家化」同样构成了整套话语表述。事实上,「中心化」、「极权」、「专制」、「草台班子」、「减速」等话语建构构成了 Web3 的道德基础,而代表着进步的「加速」则赋予了 Web3 革命的天然正当性。

什么是有效加速主义(Effective Accelerationism,网络上一般简写为 e/acc)?笔者在此择选一个被普遍接受的含义,而它更多指向了右翼加速主义:

有效加速主义是一种基于热力学第二定律的信念,即宇宙本身是一个创造生命并不断扩张的优化过程。这种扩张的引擎是技术资本。该发动机无法停止。进步的车轮只会朝一个方向转动。

这一流派以 Nick Land 为代表,它启发了美国新保守主义运动。没错,它们是保守的而非激进的,尽管它们拥抱现代技术,但却否定了具有普世价值的民主、人权与自由。

有效加速主义尊崇自然律,认为技术就像自然界一样可以无限地增熵,并且否认这是一种意识形态与运动,而是对真理的承认。在他们看来,技术资本(Technocapital,Viviana Rojas 于 2012 年提出)是一个不可阻挡的物理过程。

有效加速主义是对技术官僚控制的打击,是对末日论者和减速论者的打击,他们希望我们消耗更少的自由能,创造更少的熵。自上而下的控制只会降低文明的维度。

有效加速主义忽略了一点,这个世界是由人所构建的,文明是由人所创造的,而文明的本质是负熵,它不断地在做熵减。成熟的文明意味着建立了一套社会秩序,这个秩序必然是稳定的,将不可控的、不确定性的事物纳入可控的秩序当中,或是压缩在社会最阴暗的角落。近代科学诞生以来,人类社会便加速世俗化进程,科学对于世界有依据的认识战胜了宗教的不可知论。因为科学在自己的边界内无法证伪,也意味着科学的知识都是为人类可以掌握的。文明同样如此。换言之,有效加速主义的逻辑自洽在哲学上存在挑战。

有效加速主义者往往是彻头彻尾的科技精英,他们掌握着这个时代与未来走向最核心的话语与权力。在他们看来,历次工业革命与技术变革人类都可以适应,那么人类也将适应 AI。加速!加速!加速!这是有效加速主义者的口号,任何妨碍技术无限进步的都该反对。而对于 Web3 有效加速主义者来说,「加速」还要与「去中心化」合谋。我们知道,任何政治构建都是讲故事,不同的政治斗争实质上就是不同「故事」(政治阐述)之间的对抗。当某个故事及其话语体系被广泛接受时,权力也就随之而生。有效加速主义者将人工智能末日论与减速论并列,并将其塑造为自己的对立面,一个不同于自我意识形态的他者,来述说自己的政治叙事。民族国家注定走向衰亡,加密与去中心化的政治叙事就要成为绝对的真理与历史的终结。

在 OpenAI 事件刚爆发之际,对安全、公司治理结构的合理猜测成为有效加速主义者的话柄。他们的政治叙事即「去中心化」、「去国家化」、「去中心化治理」,这迎合了 OpenAI 董事会被质疑的「奇葩」、「独裁」、「不透明」的治理结构。

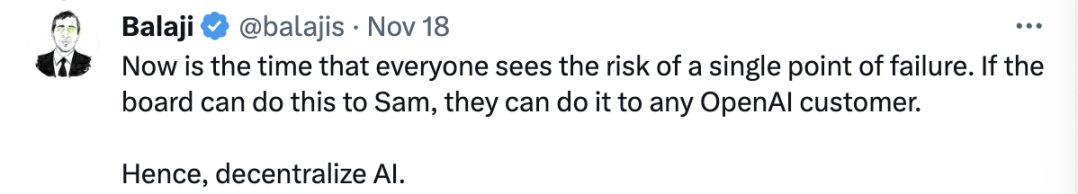

11 月 18 日,Balaji 的第一篇关于 OpenAI 的推文写道:「末日论者最终信任的是中央集权国家,就像自由主义者在 911 事件后相信《爱国者法案》一样;而有效加速主义则信任去中心化网络」,「从根本上说,末日论者相信哈里斯能够监管超级智能。同时,有效加速主义认为创建模型的技术专家比那些甚至不了解模型并且讨厌技术的国家主义者更有能力减轻任何负面影响」。在此,Balaji 认为,AI 领域的技术专家与进行「监管」的国家应是对立的,AI 领域可以进行自监管,而无需国家的介入。

随后,Balaji 试图在 AI 与 Web3 之间建立同盟。他声称「如果董事会可以这样对待 Sam,他们也可以这样对待任何 OpenAI 客户。人工智能需要去中心化。」「如果事实证明,狂热的人工智能末日论者导致了像 GDB 这样的新一代人才外流,那么每一个有价值的人工智能组织都会立即将末日论者从控制岗位上清除出去。 」OpenAI 董事会已经被塑造为一个「狂热的 AI 末日论者」,他期望着所有 AI 企业都是与之相对的道德圣人,「在毁灭者毁灭你之前,先除掉他们」。

在 Balaji 看来,OpenAI 不开源就是一种恶,只有像 Meta 研发的「Llama 2」一样的开源语言大模型才是绝对的正确:

「唯一的出路就是加速 + 去中心化」,Balaji 给出了方向,并就此加深了对「国家主义」的反动:「如果您从事 AI 领域,请转向去中心化。 人工智能领域的每个人都上了一堂课:(a)对公司拥有主权;(2)技术的去中心化;(3)独立于国家主义意识形态。要想有效加速,我们需要去中心化! 现在,每个人都看到了单点故障的风险。如果董事会可以这样对待 Sam,他们也可以这样对待任何 OpenAI 客户。因此,人工智能要去中心化。 」

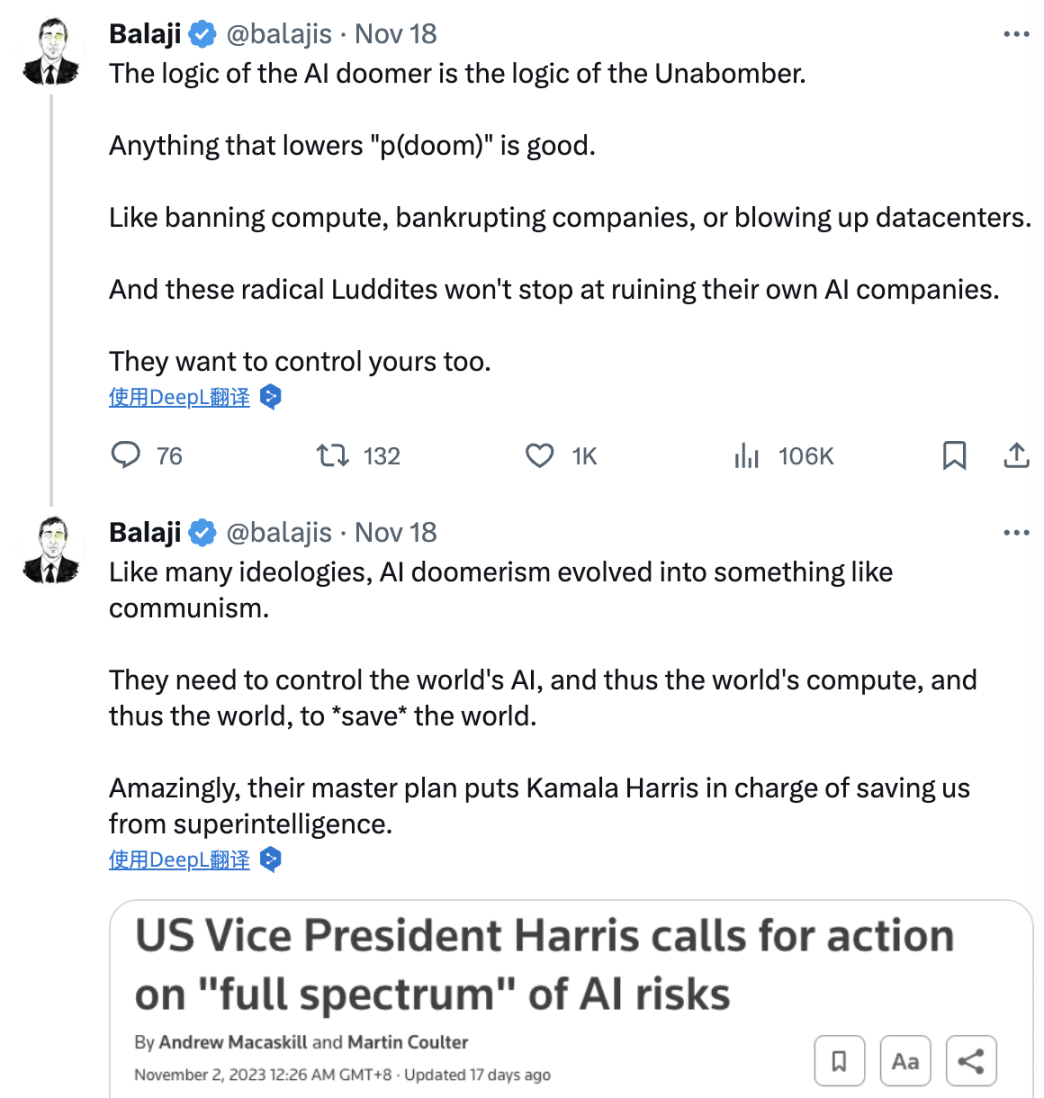

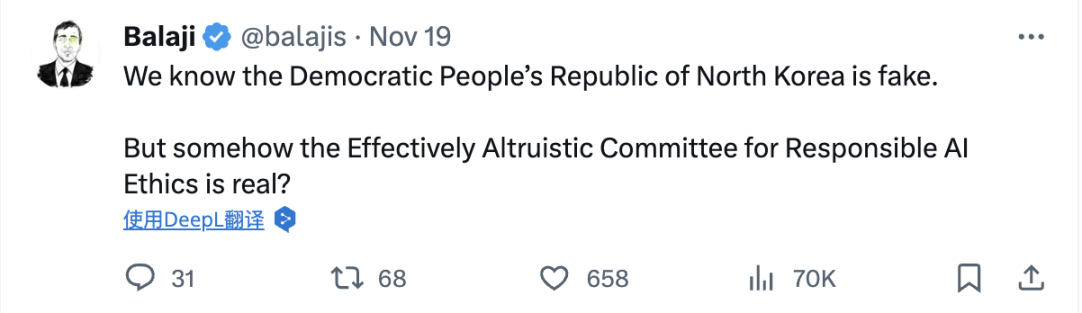

作为《网络国家》的作者,Balaji 再次开始了他的表演:「AI 末日论者的逻辑就是智能炸弹客的逻辑。任何能降低 p(doom) 的东西都是好的。比如禁止计算、让公司破产或炸毁数据中心。这些激进的卢徳分子(指的是 19 世纪初英国手工业工人中参加捣毁机器的人)不会止步于毁掉他们自己的 AI 公司。他们也想控制你的公司。 与许多意识形态一样,AI 末日论也演变成了类似共产主义的东西。他们需要控制全世界的 AI,从而控制全世界的计算,进而控制全世界,以『拯救』世界。令人惊讶的是,他们的总体计划让哈里斯负责从超级智能中拯救我们。」

在政治口号喊出来后,Balaji 将矛头转向 OpenAI 的另一个标签「非营利组织」:「非营利组织毁了旧金山,现在又毁了旧金山最好的公司。他们名副其实,非营利组织无利可图。是的,有些原则上的例外。比如 EFF。它做得很好。但我们需要重新考虑非营利组织的激增问题」。是的,他们为了自己的政治叙事,也否定了「非营利组织」。Web3 不再谈论 OpenAI 作为非营利组织的「理想主义」初衷,不再颂扬「造福人类」的理想,只是轻描淡写一句不负责任的话:「它变了」。是啊,变了,多么大的转折,要么更好、要么更差,非此即彼。非营利组织不重要、变了多少不重要、如何变得不重要,重要的是变了,话语的影响就在于此。

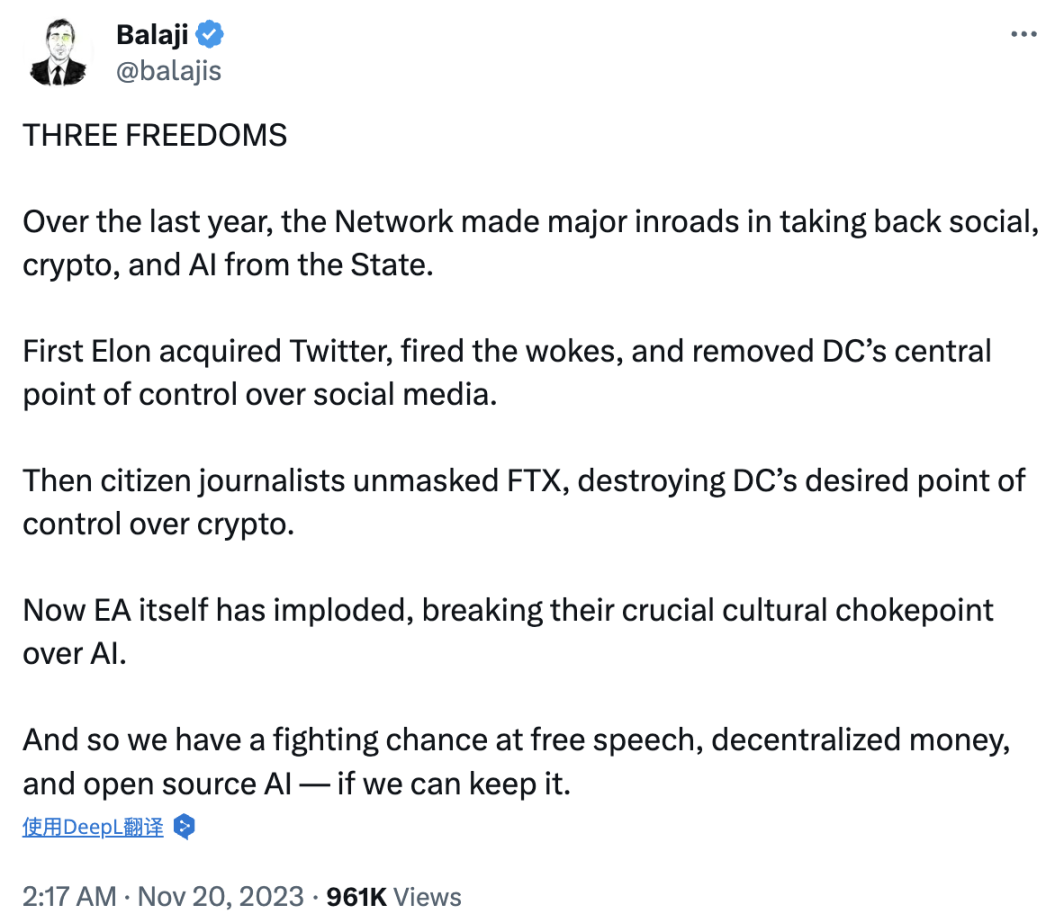

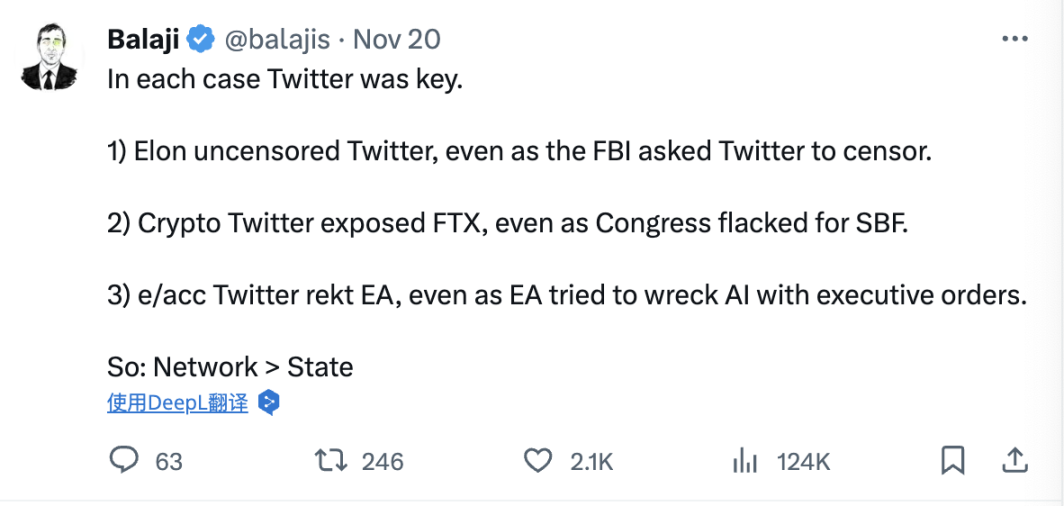

更有意思的是,Balaji 的功利主义似乎让他迷失了自己,他的目标只剩下「网络国家」。Twitter 成为了 Balaji 口中对抗另一个主权国家的利器,他过分地褒扬了马斯克,却忘记了这是一个最大的独裁者,Balaji 在赞扬一个他所极力反对的人与事:

「减速论者有国家,但我们有网络。」

「过去一年,网络在从国家手中夺回社交、加密货币和 AI 方面取得了重大进展。首先,马斯克收购了 Twitter,解雇了唤醒者,解除了华盛顿特区对社交媒体的核心控制。然后,公民记者揭露了 FTX,摧毁了华盛顿特区对加密货币的理想控制点。现在,有效利他主义也发生了内讧,破坏了他们对 AI 的关键文化控制点。因此,我们有机会争取言论自由、去中心化货币和开源 AI。」Balaji 称,「在每一件事中,Twitter 都是关键」,「即使 FBI 要求 Twitter 进行审查,马斯克也没有对 Twitter 进行审查;Twitter 上的加密社区曝光了 FTX,即使国会为 SBF 开脱;Twitter 上的有效加速主义斥责有效利他主义,即使有效利他主义试图通过行政命令破坏 AI」。

Balaji 说的一点都没错,OpenAI 事件能有如此大的传播离不开 Twitter。他与技术圈名人响马都从发生学的角度指出这场舆论的另一个制造剂——舆论发生的场域 Twitter。是的,没有中心化而又独裁的 Twitter,怎么会有 Balaji 口中与国家进行夺权的「网络」?

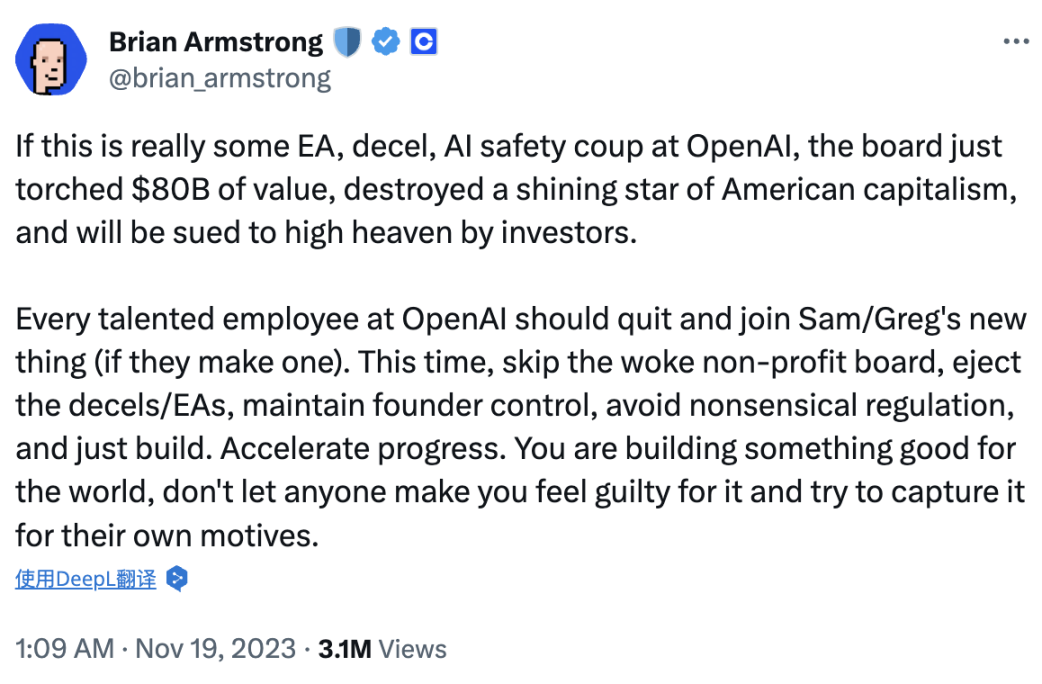

为什么「有效利他主义」被这群 Web3 大佬所厌恶?那自然离不开 SBF 与他的 FTX 帝国。SBF 在大学时期就深信有效利他主义,「赚最多的钱,捐给更多的人」。但 FTX 的暴雷对整个加密行业造成了巨大的冲击,「恨一个人也要恨他的信仰」,「有效利他主义」从此「臭名昭著」。在 Brian Amerstrong 看来,

如果这真的是 OpenAI 的有效利他主义、减速论、AI 安全政变...OpenAI 的所有优秀员工都应该辞职,加入 Sam / Greg 的新公司(如果他们有新公司的话)」。这一次,跳过掌权的非营利性董事会,去除减速论 / 有效利他主义,保持创始人的控制权,避免无意义的监管,只管建设,加速。你们正在创造美丽新世界,不要感到内疚,要为了自己的动机而夺取它。

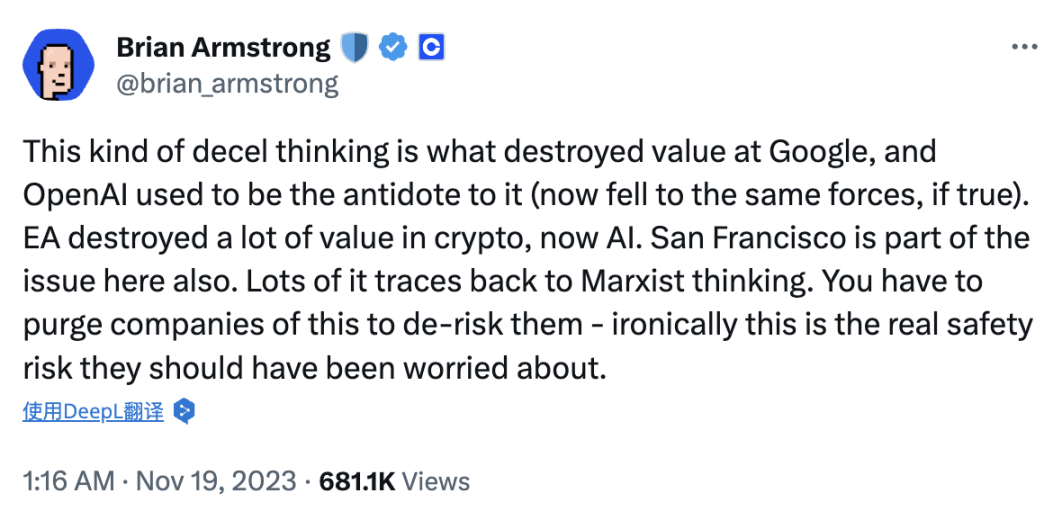

这种减速思维摧毁了谷歌,而 OpenAI 曾经是谷歌的解药(如果属实,现在也倒在了同样的力量之下)。有效利他主义毁掉了加密货币的大量价值,现在又毁掉了人工智能。旧金山也是问题的一部分。很多问题都可以追溯到马克思主义思想。你必须清除公司存在的这种风险——讽刺的是,这才是它们本应担心的真正安全风险。

如 Balaji 的自我矛盾一样,Brian Armstrong 也有一番宏论,他认为「OpenAI 董事会的存在不是为了赚钱或使股东价值最大化」可能是个「错误」。

除此之外,a16z 普通合伙人 Sriram Krishnan 也持同样观点:「有效利他主义可能才是我们这里很多人应该关注的坏人(villain)。」

Web3 有效加速主义用极具对立性的「话语」来述说自己的政治诉求,但却遮蔽了很多人与事的多样性与复杂性。

在这场话语建构当中,Web3 在去中心化、有效加速主义方面的话语建构来源之一就是对 AI 界对安全的考量。AI 安全涉及到现代国家治理术、技术资本主义与生命政治,在现代国家治理中,任何技术议题也就理所当然地要迎合国家意志,因此有效加速主义者的话语建构也就无法脱离整体的国家议程。

本文暂不追溯太远,但自 2021 年以来,拜登 - 哈里斯政府就一直致力于控制与管理 AI 风险。OpenAI 在这一议程中也起到重要作用,推动了美国 AI 风险管理框架的建立与实施。

早在 2019 年 6 月,OpenAI 曾回复美国商务部国家标准与技术研究院(NIST)应如何制定美国与国际 AI 标准,并指出将特别关注「可靠、稳健与可信」的系统,希望提高人工智能系统可预测性、稳健性和可靠性。OpenAI 认为,AI 的安全性包括「确保系统在与人类交互时不会对人类造成身体伤害;确保系统将与人类核实与其即将采取的行动相关的关键决策;确保 AI 系统提出的建议尊重人类的限制和系统运行的大环境」。它们主张,美国需制定 AI 技术国际标准,「让监管基础设施为大规模、多用途的 AI 系统做好准备」。

拜登政府组建后,美国国家人工智能研究资源工作组于 2021 年 6 月成立,旨在帮助创建和实施国家 AI 研究资源蓝图。随后,NIST 召开 AI RMF(AI 风险管理框架)研讨会,AI RMF(AI 风险管理框架)正式提上议程。2022 年 3 月,NIST 就 AI RMF 草案征求意见。OpenAI 此时对 NIST AI 风险管理框架初稿进行评论,表示将响应 NIST 的要求,并指出 NIST 应考虑将与人类价值观和意图保持一致纳入其指导原则,即确保与人类价值观与意图保持一致的 AI 系统能够可靠地按照人类意图行事。

2022 年 11 月,GPT-4 的诞生进一步加快了拜登政府对 AI 领域的风险管理。2023 年 1 月 25 日,美国国家标准与技术研究院(NIST)正式发布 AI 风险管理框架(RMF),以提高 AI 的可信度,确保组织能够以不同方式思考 AI 及其风险。3 月,NIST 启动「可信与负责任的 AI 资源中心」,以促进 AI RMF 的实施。

2 月,拜登政府发布一项关于促进种族平等的行政命令,其中表示要「促进科学公平,消除人工智能等新技术设计和使用中的偏见」,保护公众免受算法歧视。随后,美国联邦贸易委员会、消费者金融保护局、平等就业机会委员会与司法部民权司发表联合声明,决定监督自动化系统开发与使用,并指出自动化系统可能在数据集、不透明、设计与使用等方面助长非法歧视且违反联邦法律。

5 月 4 日,哈里斯会见 Alphabet、Anthropic、微软和 OpenAI 四家科技公司 CEO,以强调负责任的 AI 创新,在抓住机遇之前降低其风险。5 月 23 日,拜登 - 哈里斯政府发布公告,并对自 2019 年以来尚未更改过的 AI 研发计划进行更新——《国家人工智能研发战略计划:2023 更新》。该路线图将推进负责任的 AI 研究、开发与部署,并再次强调需在抓住 AI 机遇之前首先管理其风险。同时,联邦政府的投资重点将是促进负责任的美国创新、服务于公共利益、保护人民权利和安全以及维护民主价值观的 AI 研发。在这份文件中,美国国家科学基金会还宣布拨款 1.4 亿美元,新建 7 个国家人工智能研究所,使全国机构总数达到 25 个。

6 月,拜登与技术和社会交叉领域的专家进行 AI 的前景与风险圆桌讨论。

7 月,哈里斯召集消费者、劳工与民权领袖讨论 AI 的相关风险。

随后,拜登召集亚马逊、Anthropic、谷歌、Inflection、Meta、微软和 OpenAI 等 7 家公司,宣布拜登 - 哈里斯政府已获得这些公司的自愿承诺,以帮助实现安全、可靠和透明的 AI 技术发展。他们承诺:

在向公众推出产品之前确保其安全;

构建将安全放在首位的系统;

赢得公众的信任。

10 月 30 日,拜登签署《关于安全、可靠和可信地开发和使用 AI 的行政命令》,明确表示将限制硅谷在 AI 产品经过全面测试之前发布产品的倾向。

基于拜登在 10 月 30 日的行政命令,哈里斯在 11 月 1 日访问英国时宣布美国正在通过商务部在 NIST 内建立美国人工智能安全研究所,以实施 NIST AI RMF。同时,美国也已发布首份关于美国政府使用 AI 的政策指南草案,包括《人工智能权利法案蓝图》、AI RMF、负责任地将 AI 和自主权用于军事用途的政治宣言、与 AI 相关的慈善组织发起的倡议、防 AI 欺诈、内容认证国际规范等。

拜登 - 哈里斯政府在 AI 方面的议程涉及人工智能安全、生物武器风险、国家安全、网络安全、隐私、偏见、公民权利、算法歧视、刑事司法、教育、工人权利和研究等各方面。而 Web3 有效加速主义者将一箩筐的内容全都将其作为国家的叙事范畴当作讨伐的对象,在这里,只需要否认国家、中心化与集权就可以选择性地无视复杂多样的全球性问题。似乎,只要获得一片中立的领土建立「网络国家」就可以一劳永逸地躲避世俗世界的喧嚣。

拿去滤镜,来看看真实的人吧。有媒体报道,越来越多的人工智能业内人士正在猜测人工智能将给人类带来灾难性后果的概率,并计算末日的「p(doom)」。那么,作为 OpenAI 的前 CEO,Sam Altman 是一个有效加速主义者吗?在 Web3 有效加速主义者的话语中,Sam Altman 是「加速主义」的代表,「造福全人类」的董事会只有成为「有效利他主义者」、「减速论者」。

OpenAI CTO、DALL-E 与 ChatGPT 团队领导者 Mira Murati 在今年 2 月《时代》杂志采访时公开表示:

我们甚至对 ChatGPT 的出现感到些许不安,我很好奇它会在哪些领域开始为人们带来实用性,而不仅仅是新奇与纯粹的好奇;

关于社会影响还有很多问题,我们需要考虑很多伦理与哲学问题。重要的是我们要引入不同的声音,比如哲学家、社会科学家、艺术家和人文学者。

[AI] 可能被滥用,接下来的问题是如何在全球范围内管理这项技术的使用。如何以符合人类价值观的方式管理人工智能的使用?

尽管 AI 带来了很多不确定性,但 Mira Murati 总体是乐观的。

为大多数人所知并造成恐慌的是 2023 年 3 月,马斯克等人呼吁的暂停至少 6 个月的比 GPT-4 更强大的人工智能系统训练公开信。或许,AI 技术的发展似乎超出了这些科技精英的预料。

真正从事技术研发的 OpenAI 首席科学家 Ilya Sutskever 曾说,「在某些时候,一些别有居心的人可以利用他们向任何愿意付费的人提供的模型很容易造成巨大伤害」。

在 11 月《卫报》发布的纪录片《Ilya:塑造世界的 AI 科学家》中,Ilya 提问了 AI 技术是否会对人类有益的问题。该视频首先展映 Ilya 的担忧:「AI 会使网络攻击更加极端,会创造完全自动化的 AI 武器,无限稳定的独裁政权」。因此,对他来说,「第一批 AGI 的信念与愿望尤为重要,对它进行正确的编程尤为重要,如果不这样做,那么进化和自然选择的本质就会偏向那些将自身生存置于首位的系统」,「并不是说它们会伤害人类,而是因为它会太强大」。Ilya 举了人对待动物的例子进行类比:

人类在修高速公路时不会征求动物的同意,人与 AGI 的关系也是如此,AGI 是真正自主并代表自己运作的。很多机器学习专家并未意识到神经网络和 AI 的计算速度将在未来几年突破几十万倍,而他们并没有足够的时间来确保他们构建的 AGI 能够深深地关心人类。

只不过多思考了一些人类的未来处境,Ilya 就成了要被清除出去的人工智能末日论者,但他从未说 AI 会毁灭人类,只是反思 AI 的强大会带来相应的危险。「AI 末日论」的形象塑造不得不归功于《卫报》给 Ilya 给他制作的纪录片——显而易见的末日感。

作为加速主义者,Sam Altman 在 Web3 有效加速主义者的话语构建中也有着天然的正当性。作为 Web3 项目 Worldcoin 的创始人,他也是 Web3 最有机会拉拢的对象。但 Sam Altman 完全信奉有效加速主义吗?也不尽然,他的思想中也有着出于人类关怀的减速思考。

今年 2 月,Sam Altman 发表「Planning for AGI and beyond」。在这篇文章中,Sam Altman 承认 AGI 会带来的「严重误用、严重事故与社会混乱的风险」,也表示 AI 需要持续迭代以解决当前问题,并通过「逐步过渡」确保人类可以逐步适应:

目前,我们认为成功应对人工智能部署挑战的最佳方法是通过快速学习和仔细迭代的紧密反馈循环。社会将面临人工智能系统可以做什么、如何消除偏见、如何应对工作岗位流失等重大问题。最佳决策将取决于技术所采取的路径,与任何新领域一样,迄今为止大多数专家的预测都是错误的。

Sam Altman 也是开源、民主与去中心化的忠实拥趸:

我们认为世界上更多地使用人工智能会带来好处,并希望促进人工智能的发展(通过将模型放入我们的 API、将其开源等)。我们相信,民主化的访问也将带来更多更好的研究、去中心化的权力、更多的利益,以及更多的人贡献新的想法。

但这并不是 Sam Altman 的全部,他追求技术的进步,也并未否认「安全」的重要性:

重要的是,我们认为在人工智能的安全性和能力方面,我们往往必须同时取得进展。把它们分开来谈,是一种错误的对立;它们在很多方面都是相关的。我们最好的安全工作来自于与能力最强的模型合作。尽管如此,重要的是要提高安全进展与能力进步的比例。

他表示 OpenAI 正在建立一种激励措施,使其与良好的结果保持一致。具体而言:

协助其他组织提高安全性;

对股东的回报设定上限;

在安全需要时取消对股东的股权义务;

赞助世界上最全面的全民基本收入实验;

在发布新系统之前接受独立审计;

同意限制用于创建新模型的计算增长率;

建立 AGI 工作何时应停止训练、决定模型可以安全发布或从生产使用中撤出模型的公共标准;

世界主要政府对一定规模以上的培训有深入的了解;

...

这篇文章的最后,Sam Altman 表示「人类的未来应由人类自己决定,与公众分享进步的信息很重要」,AGI 有能力一直加速,届时「世界可能会与今天截然不同,而且风险可能会非常大」。他认为「较慢的起飞更容易确保安全,而且在关键时刻协调 AGI 减速的努力很可能非常重要(即使在我们不需要这样做来解决技术调整问题的世界里,减速可能也很重要,因为这样可以给社会足够的时间来适应)」。

再举一例。今年 3 月,Sam Altman 在接受 ABC News 采访时也表示,AI 将能重塑社会,但对当前的发展「有点害怕」。他认为,监管机构与社会应尽可能参与 ChatGPT,并表示会与政府官员保持「定期联系」。Altman 表示,「我特别担心这些模型可能会被用于大规模虚假信息」与「进攻性网络攻击」。他从不担心 AI 模型不需要人类便可自己做出决定并策划统治世界。「这是一种很大程度上由人类控制的工具」,值得担心的是哪些人会控制 AI。Altman 仍然希望不断开发越来越强大的系统,将其融入日常生活与经济,「成为人类意志的放大器」。在 Altman 看来,GPT-4 的推理能力仍然不足,持续完善并构建一个由人控制的推理引擎或许是他选择进一步开发 GPT-5 的原因。Altman 相信,AI 的技术进步并不会消解社会与人的意义。

今年 5 月,Sam Altman 在美国参议院司法小组委员会上发表讲话,指出 AI 可以解决人类最大的问题,但也警告说 AI 的力量足以以不可预测的方式改变社会,「政府的监管干预对于减轻风险至关重要」。Altman 称,「我最担心的是我们科技行业对世界造成重大伤害」,「如果这项技术出了问题,它可能会变得非常糟糕」。

事实上,通过对 Mira Murati、Ilya Sutskever 与 Sam Altman 的话语分析,我们可以发现 Ilya 并非是一个 AI 末日论者,他只是从科技与人文的视角表达了自己对人类未来的思考;Sam Altman 也在认可着相应的监管、安全、减速与利他主义。显而易见的是,Balaji、Brian 等人为了自己目的而进行的话语建构,有效加速主义者在塑造一个虚假的、符合其意识形态的 Sam Altman 与 OpenAI 内斗叙事。AI 要让人类生活变得更美好,但有效加速主义者只能依靠中本聪的政治叙事表现自己的「目的」与「手段」。

故事的主角 Sam Altman 也坚信着 AI 并非全知全能的上帝,而是由人所控制的工具。他的 Worldcoin 是多么地理想主义,一个去中心化的项目依然要实现比特币的理想,确保全民基本收入;但 Web3 有效加速主义却裹挟着精英的傲慢,他们垄断着资本(Coinbase、a16z)、加密叙事(去中心化)与话语政治(去国家化),或许他们才是真正的独裁者。

在 AI 科学家眼中,人才是目的。但在 Web3 有效加速主义的眼中,「加速」是手段,「去中心化」是目的。

很显然,为了制造出一个的革命对象,Web3 有效加速主义者只有宣称「加速」、「技术的无限进步」、「去中心化」。在他们所遵循的线性的、进步的时间中,技术才是主体,人都是需要随之适应的「他者」。拉克劳的话语政治表明技术终将与资本融合,而技术进步的话语权永远掌握在少数精英手中,作为硅谷的圣经,「有效加速主义」也确实是这样做的。他们在建构一种话语政治,这并非齐泽克口中的拒绝「讲故事」的怪物,怪物是非人的,而这个世界依旧建立在普遍人性之上,难以像希特勒一样对这个世界进行毁灭性的打击而后重建。因为有叙事,才有了话语政治。

在有效加速主义者看来,任何妨碍加速的因素都应反对;那么对 Web3 有效加速主义者来说,所有妨碍去中心化的因素就都应反对。不管你是理想主义的、非营利的、利他的,只要与「加速」、「去中心化」的叙事不合,都是要被扔进垃圾桶进行唾骂的对象(在这里,加速或许都已成为一种政治言说的工具)。通过建构起一个「有效利他主义的」、「减速的」 AI 来证明 Web3 才是目的论的终点。在 Web3 看来,尽管 AI 从业者创造了颠覆性的 GPT-4,但依然是活在传统中的碳基生物,瓦解中心化结构与民族国家的 Crypto 与 Web3 才是终极的答案。但除了比特币、DeFi 与区块链,他们已然面临着叙事的枯竭,只能选择与 AI 联合。加密从诞生开始就建立了自己敌人,若不能去中心化,不断地塑造对立,自身也就失去了存在的合理性。在这个世界上,「自我」永远要找到一个对立的「他者」,来证明自己存在的意义。

有效加速主义标榜着自己代表着建设与进步,在无形中将「减速」塑造成停滞乃至退步。但或许并非如此,因为减速依然在前进。它们为了自己的目的淡化了一个真相,那就是 AI 的技术发展是停不下来的。AI 科学家们从未否认过加速,历史正在加速,但人需要一定的减速来思考如何在这个地球上与机器共存下去。这也是执着于「加速 + 去中心化」的 Web3 有效加速主义者令人不解之处,即加速本身消解人的意义,但他们却又要求用去中心化治理来解决关于人的问题。加速追求的是效率,但去中心化却是低效的。在此,不妨引用一位 Twitter 用户对 Balaji 推文的评论:

又要加速,又要去中心化,一对奇怪的矛盾。

归根到底,他们将叙事拉回到了「去中心化」这个手段上,而从未真正去考虑「人」这个根本问题。这世界上少数的有效加速主义在持续创造新的历史,在这个普遍而又均质的时间中,整个世界都与之一起加速,跟不上的人将被淘汰,他们既没有此岸也没有彼岸,残忍又现实。

但我们依然要勇敢地面对现代世界的真相。正如 Balaji 所言,AGI 代表着上帝回来了。这个上帝是无所不能、全知全能的,只是他现在仍然被人类所控制。这一观念的背后,反映着宗教在现代世界的让步。「造神」,真正将科学塑造为宗教,所有人都是 AI 的信徒。AI 科学家们怕了,因为 AGI 可能真的代表上帝回来了。

当 Sam Altman 加入微软,OpenAI 乱局尘埃落定,恐怕也再难起波澜。在 OpenAI 政变事后分析的 Twitter Space 中,Balaji 称「Ilya、Adam 与 Emmett 都是天才技术专家,只是他们的道德观与 Sam 和 Greg 不同。这不是财务、技术与战略上的分歧。这是道德上的分歧。」这一刻,Balaji 的言辞也趋于缓和。他的话语少了不少叙事而客观了起来,他声称自己虽然不认识 Ilya,但认识 Adam D'Angelo, 「他一直是一个非常正直的人。从各种迹象来看,Emmett Shear 也是。因此,现在每家 AI 公司都需要选择自己的信念。有效利他主义 or 有效加速主义?」

Web3 也不得不接受一个真相,AI 科学家们并未接受 Cardano 开源大模型的邀请、去中心化 AI 叙事,他们并未买 Web3 的账,无论是前往微软还是回归 OpenAI,他们依然拥抱着传统 AI 科技公司。

参考文献

1. 硅谷 101:《揭秘 OpenAI 成长史:理想主义,冲突,抉择与权力斗争》,2023 年 4 月;

2. https://effectiveacceleration.tech/

3. 文理两开花:《硅谷的新图腾:「有效加速主义」(e/acc)这面大旗举的起来吗?》,2023 年 8 月;

4. 吴冠军:《话语政治与怪物政治——透过大众文化重思政治哲学》,《探索与争鸣》,2018 年第 3 期;

5. 阿列克斯·威廉姆斯、尼克·斯尔尼塞克撰文,蓝江译:《加速主义宣言:超越资本主义对技术的压制》,2018 年 3 月。